研究テーマ

感情表現と感情認識の仕組みを解明し,人々のウェルビーイングを向上させるAIの研究

人の感情表現と感情認識の仕組みを社会的機能と情報学の観点から解明し,人々のウェルビーイングを向上させるAIの実現に向けた研究を行っています.

感情はなぜ進化したか—社会的ジレンマを乗り越える心の理論

感情は内的な価値を表出するとともに,他者を制御する機能を持ちます.笑顔は関係を深め,怒りは相手を服従させ,後悔は関係を修復します.これらの「感情の社会的機能」を支えるメカニズムを,US Army Research Laboratory,南カリフォルニア大学,リスボン大学との共同研究により,バーチャルエージェントやバーチャルアバタを介した人のインタラクション実験,進化シミュレーション,ベイジアン心の理論(Bayesian Theory of Mind)を用いた計算認知モデルによって,多面的に明らかにしてきました.特に,同じ相手と複数回の同時意思決定を行う「繰り返し囚人のジレンマ」というゲームを用いて,相手が協力的か競争的かという戦略だけでなく,相手が喜びや後悔などの感情を表現することで,人がどのように意思決定を変えるかを検証しました.その結果,人間は相手が示す感情からその意図を推測し,協力的な感情を表現する相手に対してより協力的になる一方,競争的な態度や感情を示す相手には協力を控える傾向があることが明らかになりました (de Melo & Terada, 2019, 2020; de Melo, Terada, & Santos, 2021).さらに,進化シミュレーションを用いて,こうした感情表現が評判を介した間接互恵性の進化においても重要な役割を果たすことを示し,感情的社会規範がエラーの多い状況下でも協力の進化を促進するメカニズムとして機能することを実証しました (Fonseca et al., 2025).また,相互依存理論や感情の評価理論に基づいて理論的に導出された計算認知モデルを用い,人間がどのように相手の感情を解釈し,自らの行動を調整するかという意思決定プロセスを定量的に説明できることも確認しました (Terada et al., 2025).

- de Melo, C. M. & Terada, K. (2019). Cooperation with autonomous machines through culture and emotion. Plos One, 14(11), 1–12. https://doi.org/10.1371/journal.pone.0224758

- de Melo, C. M. & Terada, K. (2020). The interplay of emotion expressions and strategy in promoting cooperation in the iterated prisoner’s dilemma. Scientific Reports, 10, 1–8. https://doi.org/10.1038/s41598-020-71919-6

- de Melo, C. M., Terada, K. & Santos, F. C. (2021). Emotion expressions shape human social norms and reputations. iScience, 24(3), 1–9. https://doi.org/10.1016/j.isci.2021.102141

- da Fonseca, H. C., de Melo, C. M., Terada, K., Gratch, J., Paiva, A. S. & Santos, F. C. (2025). Evolution of Indirect Reciprocity under EmotionExpression. Scientific Reports. https://doi.org/10.1038/s41598-025-89588-8

- Terada, K., de Melo, C. M., Santos, F. C. & Gratch, J. (2025). A Bayesian Model of Mind Reading from Decisions and Emotions in Social Dilemmas. Proceedings of the 47th Annual Meeting of the Cognitive Science Society (CogSci 2025).

感情表現を通じた人-AI協力関係の適応的調整

この研究では,AIエージェントの感情表現が人とAIエージェント間の協力関係を適切に調整する重要なメカニズムであることを実証しました.囚人のジレンマゲームを用いた実験により,AIエージェントの感情表現パターンが人の協力行動を意図的に調整できることが明らかになりました.特に,自己犠牲的な感情表現(協力時に悲しみ,搾取された時に喜び)を示すエージェントに対して,人々が罪悪感なく自己利益を追求できるようになることを示しました.これは感情の逆評価(Reverse Appraisal)と呼ばれる,感情表現から相手の心的状態や選好を推測するメカニズムによるものです.この知見は,チャットボットとの対話,災害救助や軍事活動などの状況で,人がAIエージェントに対して過度に協力的になることで生じる生産性の低下や危険を軽減しつつ,AIとの効果的な協働を可能にする感情インタフェースの設計に直接応用できます.

- Emotional Expression Help Regulate the Appropriate level of Cooperation with Agents, Ryoya Ito, Celso M. de Melo, Jonathan Gratch and Kazunori Terada, The 12th International Conference on Affective Computing and Intelligent Interaction (ACII ’24), 2024.

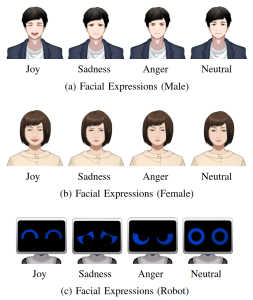

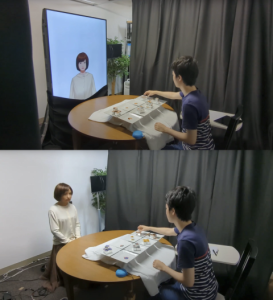

感情表現の不気味さが人とAIの交渉に与える影響:バーチャルエージェントとアンドロイドの比較

この論文では,感情表現を用いた交渉場面において,仮想エージェント(バーチャルキャラクター)とアンドロイド(人間そっくりのロボット)の効果の違いを検証しました.実験では,82名の参加者が,感情表現を見せるバーチャルエージェントまたはアンドロイドロボットと非言語的な交渉ゲームを行いました.結果として,参加者はアンドロイドよりもバーチャルエージェントの選好をより正確に推測でき,より良い統合的な解決策(双方にとって有利な取引)を実現できました.この効果は「不気味の谷」現象によって説明され,感情表現(特に喜び)を見せるアンドロイドに対して参加者が不気味さを感じることが,効果的な交渉を妨げていることが示されました.この研究は,感情表現を通じた意思決定支援システムの設計において,単に物理的な実体があることよりも,感情表現の自然さと解釈しやすさが重要であることを示唆しています.

- People Negotiate Better with Emotional Human-Like Virtual Agents than Android Robots, Motoaki Sato, Takahisa Uchida, Yuichiro Yoshikawa, Celso M. de Melo, Jonathan Gratch and Kazunori Terada, The 12th International Conference on Affective Computing and Intelligent Interaction (ACII ’24), 2024.

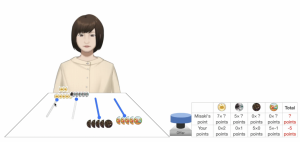

効果的な交渉を実現するAI:感情表現から選好を読み取るローカルクエリ戦略の効果

この研究では,人間とAIの交渉において,「ローカルクエリ」と呼ばれる選好探索戦略の効果を検証しています.ローカルクエリとは,交渉相手の選好(何を重視するか)を理解するため,一つの項目に注目して他を固定しながら相手の反応を観察する方法です.この研究では感情的反応のみを用いました.実験では,76名の参加者がAIとの交渉ゲームを行い,事前にローカルクエリ戦略を学習したグループとそうでないグループの成果を比較しました.結果として,ローカルクエリ戦略を学習した参加者は,AIの選好をより正確に理解し,自分の利益を損なうことなくAIにとっても有利な提案(Win-Win解)ができるようになりました.この研究は,AIとの交渉における感情表現を通じた相手理解のプロセスを明らかにし,より良い意思決定をサポートするAI開発に貢献する知見を提供しています.

- 佐藤 幹晃, 寺田 和憲. (2025). ローカルクエリが人-AI間の交渉のWinWin解に与える影響. HAIシンポジウム2025.

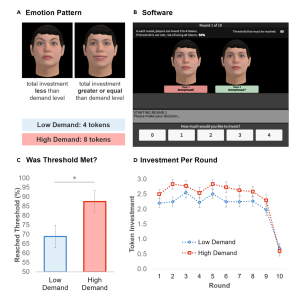

感情表現による集団リスク克服:怒りと喜びの表出が社会的ジレンマ解決に及ぼす影響

この研究では,気候変動対策などの「集団リスク状況」における感情表現の効果を検証しました.集団リスクジレンマとは,参加者が個人の利益を犠牲にして共通の目標(閾値)を達成しなければ,全員が災害リスクに直面する状況です.実験では,参加者が「高要求グループ」(投資が少ないと怒りを表出)または「低要求グループ」(投資が多いと喜びを表出)と協力する状況を設定しました.興味深いことに,ネガティブな感情である「怒り」を表出するグループと協力した参加者は,ポジティブな「喜び」を表出するグループと協力した場合よりも多く投資し,閾値達成率も高くなりました.この結果は,感情表現が集団の要求水準や期待を伝え,社会的協力行動を促進する可能性を示しています.本研究は,感情表現を通じた非言語コミュニケーションが,社会的ジレンマの解決に重要な役割を果たすことを明らかにし,より良い意思決定をサポートするAI開発に貴重な洞察を提供しています.

- Emotion Expression and Cooperation under Collective Risks, Celso M. de Melo, Francisco C. Santos and Kazunori Terada, iScience, Vol. 26, No. 11, pp. 108063, 2023. https://doi.org/10.1016/j.isci.2023.108063

笑顔の多義性研究 —社会的文脈における感情表現の機能—

この研究では,笑顔が持つ多様な社会的機能に焦点を当て,ポライトネス社会規範との関係を実験的に検証しました.人間のコミュニケーションにおいて感情表現は単なる内的状態の表出ではなく,他者に影響を与える社会的機能を持っています.特に注目すべきは,公共の場で怒りや悲しみの表出が抑制される一方で,笑顔が強制される社会環境において,笑顔が複数の意味を持つようになる現象です.実験では,エージェント間のいじめ場面を用いて,怒りと支配的笑顔が同様の支配性認識をもたらすこと,悲しみが従属性を強調し援助を引き出す機能を持つことなどが明らかになりました.この知見は,感情表現の社会的機能と文脈依存性を示すとともに,人間の非言語コミュニケーションの理解を深め,より自然な対人コミュニケーションが可能なAIの開発に役立つ重要な一歩となります.

- 笑顔の多義性ーポライトネス社会規範と語用論的笑顔の共進化ー, 松田 治真, 寺田 和憲, 人工知能学会全国大会(第38回)論文集, 2024.

人の好みや考え方を理解し,より良い意思決定をサポートするAIの開発

人の好みや考え方を理解し,より良い意思決定をサポートするAIの開発を行っています.

パーソナライズされた説得による信念操作の効果

中部電力株式会社との共同研究によって,個人の詳細な信念や価値観に基づいた情報提示を行う説得手法を提案しました.マルチ属性効用理論に基づき,完全自動運転車に対する人々の態度を変えるため,各個人が最も否定的に評価している特徴に対する反論を提示する説得対話を実施しました.197名の参加者を対象とした実験では,個人化された説得は「社会的に自動運転車を受け入れるべき」という義務感を向上させましたが,金銭的価値や乗りたい欲求には影響しませんでした.この結果は,「したい」という欲求と「すべき」という義務感が脳内で異なるメカニズムで処理されており,個人化された信念操作は高次認知プロセスに影響する一方,個人的欲求には影響が小さいと考えられます.この研究成果は,自動運転技術だけでなく,医療,教育,環境行動など,複雑な認知・動機づけプロセスを伴う様々な分野での態度変容に応用できる可能性を持っています.

- Persuasion by Shaping Beliefs about Multidimensional Features of a Thing, Kazunori Terada, Yasuo Noma and Masanori Hattori, Proceedings of the 23rd International Conference on Autonomous Agents and Multiagent Systems (AAMAS ’24), pp. 2510-2512, 2024. https://dl.acm.org/doi/10.5555/3635637.3663210

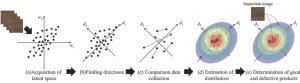

GANの潜在空間探索を用いた木目画像の官能検査技術

岐阜大学加藤邦人教授とヤマハ株式会社との共同研究によって,木製品の個体差が大きい木目の官能検査において,GANの潜在空間探索を活用した革新的手法を開発しました.StyleGAN2で木目画像の潜在特徴空間を獲得し,GANSpaceによって木目の画像的要素(縞の入り方,明瞭さ,色合いなど)を操作する方向を発見することで,検査員の感性に基づいた良品と不良品の識別境界を定量的に推定することに成功しました.この技術は,熟練検査員の言語化しづらい感性的判断基準をAIが学習し数理モデル化することで,品質管理の効率化だけでなく,技能伝承や検査基準の標準化にも貢献すると期待されています.

- GANの潜在空間探索を用いた木目画像の官能検査, 中村 友哉, 加藤 邦人, 寺田 和憲, 高橋 通一, 塩澤 安生, 相澤 宏旭, 精密工学会誌, Vol. 89, No. 2, pp. 213-220, Japan Society for Precision Engineering, 2023. (論文賞受賞)

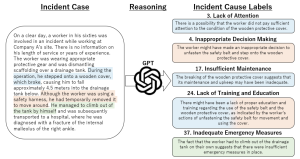

大規模言語モデルを活用した労働災害テキストの因果推論

中部電力株式会社との共同研究によって,電力会社で発生した労働災害に関するテキストデータに対して,大規模言語モデル(LLM)のGPTを活用した多ラベルアノテーション手法を開発しました.従来,組織内の非構造化テキストは効率的な知識の蓄積や再利用が困難でしたが,本研究ではLLMを用いてゼロショットおよびワンショットでのテキスト含意推論能力を検証し,災害原因の抽象的カテゴリラベルを自動付与する実験を行いました.特にプロンプトエンジニアリングを活用したワンショットアプローチでは,GPTが強い一般化能力を示し,人間のアノテーターに近いレベルのパフォーマンスを達成しました.このような手法は,人間の意思決定をサポートするAI開発において非常に重要です.災害原因を正確に分析・構造化することで,再発防止策の策定,安全教育,コンプライアンス順守,リスク管理などの意思決定プロセスを効果的に支援できます.この研究は,人間の知識や経験を補完し,テキストデータから有益なパターンを抽出することで,より良い組織的意思決定をサポートするAI技術の実用的な応用例といえます.

- Few-Shot Multi-Label Annotation of Causes for Incident Texts Using Large Language Models, Manato Nakamura, Kazunori Terada, Satoru Hayamizu, Hattori Masanori, Takafumi Fuseya and Hidetoshi Iwamatsu, Proceedings of the 28th International Conference on Knowledge-Based and Intelligent Information & Engineering Systems (KES ’24), 2024. https://doi.org/10.1016/j.procs.2024.09.501

自閉スペクトラム症のある人の社会的コミュニケーションをサポートするAIの開発

自閉スペクトラム症のある人の社会的コミュニケーションをサポートするAIの開発を行っています.

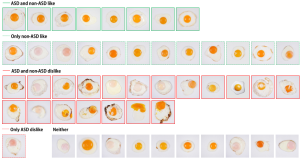

自閉スペクトラム症の偏食には「視覚」が関係している

この研究では,熊崎博一教授(長崎大学),植田一博教授(東京大学),小森政嗣教授(大阪電気通信大学),加藤邦人教授(岐阜大学)らとの共同研究によって,自閉スペクトラム症(Autism Spectrum Disorder: ASD)の成人が食べ物の見た目に対して特定の好みを持っているかを調べました.具体的には,50枚の目玉焼きの画像を用いて,ASDと非ASDの成人がそれぞれどの画像を「食べたい」と感じるかを評価しました.その結果,ASDの成人は,非ASDの成人に比べて,「食べたい」と感じる画像の範囲が狭く,特にシンプルで規則的な見た目を持つ目玉焼きを好む傾向があることが分かりました.このことから,ASDの人が示す偏食や食の選択性には,視覚的なシンプルさを好む傾向が関連している可能性が示されました.

- Terada, K., Kumazaki, H., Ueda, K., Nishikawa, N., Yoshida, H., Taki, Y., Fujii, S., Komori, M. & Kato, K. (2024, May 16). Autistic Adults Have Selective Visual Appetite for Fried Eggs. The International Society for Autism Research Annual Meeting 2024.

シンプルな運動テストで自閉症を予測

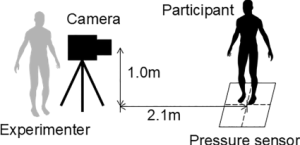

この研究では,大本義正教授(静岡大学),熊崎博一教授(長崎大学)らとの共同研究によって,片足立ちテスト中の体の動きを人工知能(機械学習)を使って解析し,自閉スペクトラム症(Autism Spectrum Disorder: ASD)の特性が強い子どもを簡単かつ高精度で予測できるか調べました.幼児が片足で立っているときの体の揺れや肩・腰の動きのデータを集め,それらを機械学習モデルに学習させることで,ASD特性が高い子どもを高い精度で判別できることを示しました.特に肩や腰の動きが重要な指標であることがわかり,短時間で手軽に行える片足立ちテストが,自閉症の早期発見やスクリーニングに有効である可能性を示しています.

- Ohmoto, Y., Terada, K., Shimizu, H., Kawahara, H., Iwanaga, R. & Kumazaki, H. (2024). Machine learning’s effectiveness in evaluating movement in one-legged standing test for predicting high autistic trait. Frontiers in Psychiatry, 15. https://doi.org/10.3389/fpsyt.2024.1464285

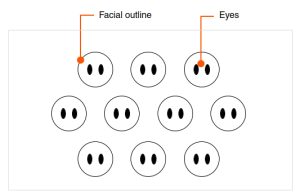

シンプルな「目」を持つバーチャル聴衆が自閉症者のストレスを減らす

本研究では,熊崎博一教授(長崎大学)らとの共同研究によって,自閉スペクトラム症(Autism Spectrum Disorder: ASD)の人が抱える「人前で話すときの不安」を軽減するため,シンプルなバーチャル聴衆を使ったトレーニングの効果を調べました.このバーチャル聴衆はシンプルな顔のデザインで,特に「目」に注意を向けさせるよう作られています.ASDの人がこのバーチャル聴衆の前で話す練習をしたところ,人前で話すことに対する自信が向上し,生理的なストレス(唾液中のコルチゾール値)が大幅に低下しました.この結果から,シンプルなデザインで目に注目させるバーチャル環境が,ASDの人が人前で話す際の不安軽減や自信の向上に効果的である可能性が示されました.

- Kumazaki, H., Muramatsu, T., Kobayashi, K., Watanabe, T., Terada, K., Higashida, H., Yuhi, T., Mimura, M. & Kikuchi, M. (2020). Feasibility of autism-focused public speech training using a simple virtual audience for autism spectrum disorder. Psychiatry and Clinical Neurosciences, 74(2), 124–131. https://doi.org/10.1111/pcn.12949

意図スタンス,設計スタンスの研究:人はロボットに「意図」を見いだすのか

ロボットは単なる機械です.しかし,人は無生物である機械に対して心や意図を感じることがあります.本研究では,そうした人間の認知戦略がどのように切り替わるのかを,意図スタンス・設計スタンスという二つの視点から探究しています.具体的には,ロボットや人工エージェントが示す行動パターンに対し,人が意図的な存在として扱うのか,それとも機械的アルゴリズムとして理解するのかを実験的に検証し,ロボットと人間のより自然な相互作用の実現に向けた知見を得ることを目指しています.

ロボットの反応的な動きは人に意図を感じさせるのか

本研究では,非ヒューマノイド型ロボットが示す動作が,人に「ロボットが何らかの意図をもって行動している」と解釈されるメカニズムを明らかにしています.具体的な実験としては,椅子型や立方体型のロボットを用意し,それらが人間の動きに合わせて反応的に移動する条件と,一定の周期で機械的に動く条件を比較しました.すると,人間が自らの行動に追従して動くロボットに対しては,単なる物理現象としてではなく「自分を見て行動している」「何らかのゴールや目的がある」といった意図を感じやすいことが分かりました.加えて,ロボットの外観が機能的な形状(椅子)か抽象的な形状(立方体)かによっても,人間が感じる意図やゴールの帰属に違いが生じることが示され,ロボット設計や人間との自然な相互作用における重要な知見が得られています.

- Terada, K., Shamoto, T., Mei, H. & Ito, A. (2007). Reactive Movements of Non-humanoid Robots Cause Intention Attribution in Humans. IEEE/RSJ International Conference on Intelligent Robots and Systems, 2007 (IROS 2007), 3715–3720. https://doi.org/10.1109/IROS.2007.4399429

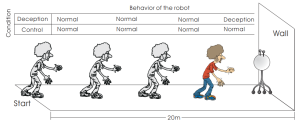

ロボットは人を騙せるのか

この研究では,ロボットが予測を裏切る行動をとったとき,人は「騙された」(騙す意図がある)と感じるのかを実験的に検証しています.具体的には,日本の子どもの遊び「だるまさんがころんだ」に近いルールを導入し,ロボットがあえて人間の予測とは異なる動きやタイミングで振り向くように設定しました.その結果,普段は一定のペースで行動していたロボットが,突然高速でターンして人間の行動を“見破る”ように振る舞うと,被験者は「ロボットに出し抜かれた」「騙された」と認知しやすいことが示されています.機械的な装置に対しても,人がそこに策略や意図を読み取ってしまう可能性を示す事例となっています.

- Terada, K. & Ito, A. (2010). Can a Robot Deceive Humans? Proceeding of the 5th ACM/IEEE International Conference on Human Robot Interaction (HRI 2010), 191–192. https://doi.org/http://doi.acm.org/10.1145/1734454.1734538

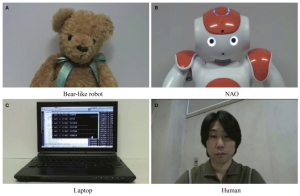

人間的外見か機械的外見か:競争ゲームにおける意図読みと行動読み

本研究では,人間に近い外見や仕草をもつエージェントと,より機械的な外見のエージェントを相手に競争的なゲームをプレイする際,人がどのように相手の行動を理解・予測し,どんな戦略をとるのかを比較しました.具体的には,複数回のゼロ和ゲーム(ペニーマッチングゲーム)を行い,相手が規則的な行動から突然「騙し」のような行動へ切り替える局面を設定し,被験者が相手を意図的存在とみなすか,単なるアルゴリズムとみなすかを調べています.その結果,人間的な外見のエージェントに対しては心的状態を積極的に読み取り,不規則な混合戦略をとりやすいのに対し,ロボットやコンピュータのような外見の場合は行動パターンを見抜いて搾取する(予測可能なパターンを利用する)戦略になりやすいことが分かりました.これは,人が相手の外観や振る舞いを手がかりに,意図スタンスと設計スタンスを使い分ける認知プロセスを持っていることを示唆しています.

- Terada, K. & Yamada, S. (2017). Mind-Reading and Behavior-Reading against Agents with and without Anthropomorphic Features in a Competitive Situation. Frontiers in Psychology, 8, 1–10. https://doi.org/10.3389/fpsyg.2017.01071